Edge AI w Twojej kieszeni: jak smartfon stał się najinteligentniejszym urządzeniem

Sztuczna inteligencja długo pozostawała domeną odległych centrów danych, gdzie chmura analizowała informacje z zauważalnym opóźnieniem. Dziś jej najbardziej zaawansowana forma działa dosłownie pod naszymi palcami, w smartfonach. To rewolucja Edge AI, czyli przetwarzanie bezpośrednio na urządzeniu końcowym, które przekształciło telefon z biernego terminala w samodzielne centrum decyzyjne. Fundamentalną rolę odegrało tu powstanie wyspecjalizowanych układów neuromorficznych, takich jak NPU, stworzonych wyłącznie do błyskawicznych obliczeń AI. Dzięki nim nasze urządzenia nie muszą już odsyłać każdego zdjęcia czy polecenia głosowego na zewnętrzne serwery w celu interpretacji. Cały proces odbywa się lokalnie, co zapewnia natychmiastową reakcję, wzmacnia ochronę prywatności i znacząco oszczędza energię.

Ta zmiana ma namacalny wpływ na codzienność. Aplikacja do zdjęć potrafi zastosować zaawansowane poprawki, analizując scenę jeszcze przed naciśnięciem migawki. Asystent głosowy rozpozna twoje słowa bez aktywnego połączenia z internetem, a tłumacz przełoży rozmowę w locie, działając jak dyskretny przewodnik. Systemy uczą się indywidualnych nawyków, optymalizując pracę baterii czy zarządzając powiadomieniami w sposób spersonalizowany i nieinwazyjny. To już nie sztywny algorytm, a proces ciągłej adaptacji.

W porównaniu z dawnym modelem chmurowym, różnica jest jak między rozmową przez łączność satelitarną a swobodną konwersacją w cztery oczy. Edge AI eliminuje opóźnienie, tworząc wrażenie płynnej, niemal intuicyjnej interakcji. Kierunek rozwoju wskazuje na coraz większą autonomię. Wyobraźmy sobie telefon, który nie tylko zidentyfikuje obiekt w obiektywie, ale też zrozumie jego kontekst – widząc kwitnącą roślinę, sam zasugeruje optymalny termin podlewania, uwzględniając lokalną prognozę pogody. Wyposażony w tę kieszonkową inteligencję smartfon przestaje być zwykłym narzędziem, a staje się proaktywnym partnerem, który myśli wraz z nami, strzegąc przy tym naszych cyfrowych granic.

Od chmury do czujnika: dlaczego przetwarzanie na krawędzi sieci rewolucjonizuje IoT

Przez lata rozwój Internetu Rzeczy był ściśle uzależniony od modelu chmurowego. Dane z milionów czujników wędrowały do odległych centrów przetwarzania, by po analizie wrócić z decyzją lub poleceniem. Ten model, mimo swojej mocy, ujawnił poważne ograniczenia w obliczu realnych wymagań przemysłu, transportu czy medycyny. Opóźnienia transmisji, ogromne wolumeny danych przeciążające łącza oraz wrażliwość informacji na przechwycenie stały się barierą dla bardziej zaawansowanych zastosowań. Odpowiedzią jest przetwarzanie na krawędzi sieci, które przenosi moc obliczeniową tam, gdzie dane powstają – do bramek sieciowych, samych urządzeń lub lokalnych serwerów.

Rewolucja tkwi w radykalnej zmianie filozofii. Zamiast pytać „jak szybko dostarczyć dane do chmury”, przetwarzanie brzegowe stawia pytanie: „jaką decyzję można podjąć lokalnie, natychmiast”. Weźmy za przykład autonomiczny wózek widłowy w magazynie. Dzięki analizie wideo prowadzonej przez wbudowany układ AI, może on w ułamku sekundy wykryć przeszkodę i zahamować, nie oczekując na reakcję serwera oddalonego o setki kilometrów. W fabryce algorytmy działające na komputerze przy linii produkcyjnej analizują na bieżąco dane z czujników wibracji, wychwytując anomalie i przewidując awarie, bez przesyłania terabajtów surowych odczytów.

Kluczową wartością jest tu nie tylko prędkość, ale i autonomia oraz efektywność. Urządzenia z funkcjami przetwarzania brzegowego działają niezawodnie nawet przy chwilowym zaniku łączności, co ma nieocenione znaczenie w zdalnych lokalizacjach, na morzu czy w kopalniach. Jednocześnie do chmury trafiają jedynie przefiltrowane, zagregowane informacje lub gotowe wnioski, co drastycznie redukuje koszty transferu i przechowywania oraz podnosi bezpieczeństwo – wrażliwe dane często w ogóle nie opuszczają obiektu. To przejście od centralnego „mózgu” w chmurze do rozproszonej „sieci nerwowej” na krawędzi czyni IoT dojrzałym i zdolnym do podejmowania kluczowych decyzji tam, gdzie liczą się milisekundy i milimetry.

Kamery, które myślą: jak Edge AI tworzy nową erę widzenia maszynowego

Tradycyjne systemy widzenia maszynowego często przypominały potężne, lecz nieporadne mózgi, zmuszone przesyłać gigantyczne strumienie wideo do odległych centrów przetwarzania. Pociągało to za sobą nieuniknione opóźnienia, ogromne zapotrzebowanie na przepustowość łączy i wrażliwość na awarie sieci. Prawdziwy przełom nastąpił, gdy Edge AI przeniosła inteligencję bezpośrednio do obudowy kamery. Nowoczesne urządzenia to nie są już zwykłe czujniki rejestrujące obraz; to autonomiczne jednostki analityczne, zdolne do interpretacji sceny w miejscu jej występowania. Dzięki specjalizowanym układom, takim jak NPU, kamery z Edge AI potrafią w czasie rzeczywistym rozpoznawać obiekty, klasyfikować zdarzenia i analizować zachowania, podejmując lokalnie wstępne decyzje bez ciągłej komunikacji z chmurą.

Praktyczne skutki tego podejścia są przełomowe dla wielu sektorów. W inteligentnym mieście kamera monitorująca skrzyżowanie może nie tylko rejestrować ruch, ale też natychmiast wykrywać incydenty, takie jak kolizja czy porzucony bagaż, automatycznie uruchamiając procedurę alarmową. W fabryce system oparty na Edge AI jest w stanie w ułamku sekundy wychwycić wadę produktu na taśmie, usuwając go z dalszego procesu, co znacząco podnosi jakość i ogranicza straty. Istotną zaletą jest tu prywatność i efektywność – dane przetwarzane są lokalnie, a wysyłane dalej są tylko kluczowe metadane lub alerty, co minimalizuje ryzyko wycieku wrażliwych nagrań i redukuje koszty transferu.

Nadejście ery „myślących” kamer oznacza zatem zmianę paradygmatu z „zarejestruj i wyślij” na „zobacz i zrozum”. Edge AI przekształca kamery z pasywnych oczu w aktywne węzły decyzyjne, tworząc rozproszoną sieć inteligencji na samym brzegu systemu. To nie tylko kwestia szybszej analizy, ale przede wszystkim otwarcie drogi dla zupełnie nowych zastosowań, gdzie niezawodność, niskie opóźnienie i autonomia są kluczowe, jak w autonomicznych robotach czy rolnictwie precyzyjnym. Dzięki temu widzenie maszynowe staje się bardziej samodzielne, responsywne i w pełni inteligentne.

Bezpieczeństwo i prywatność: ukryta przewaga AI działającej lokalnie

W epoce, gdy większość usług AI opiera się na chmurze, lokalne przetwarzanie danych może wydawać się anachronizmem. Paradoksalnie, to właśnie ta pozornie mniej wygodna metoda staje się kluczową przewagą w dziedzinie bezpieczeństwa i prywatności. Gdy algorytm pracuje na twoim urządzeniu, poufne informacje – od notatek głosowych po analizowane dokumenty – nigdy go nie opuszczają. Eliminuje to ryzyko masowych wycieków z zewnętrznych serwerów, będących dziś częstym celem ataków. Lokalna AI funkcjonuje jak zamknięty ekosystem; dane nie muszą pokonywać niepewnej drogi przez internet, by zostać przeanalizowane, co radykalnie ogranicza pole potencjalnego naruszenia.

Ta filozofia przekłada się na konkretne korzyści dla użytkownika. Weźmy pod uwagę wrażliwe zastosowania: transkrypcję wizyty u lekarza, analizę finansów osobistych czy przetwarzanie nagrań z domowego monitoringu. W modelu chmurowym te dane de facto stają się własnością operatora usługi, podlegając jego politykom i podatnością jego infrastruktury. Lokalne modele, nawet jeśli mniej pojemne, zapewniają, że historia choroby czy zapis rodzinnych rozmów pozostają wyłącznie na dysku naszego komputera lub telefonu. Przywraca to poczucie realnej kontroli i własności nad informacjami, które w erze cyfrowej często bywało iluzoryczne.

Oczywiście, lokalne działanie AI nie jest panaceum i wiąże się z kompromisami, głównie w zakresie mocy obliczeniowej i częstotliwości aktualizacji modeli. Jednak w kontekście rosnącej świadomości społecznej oraz zaostrzających się regulacji, takich jak RODO, jego znaczenie systematycznie rośnie. Dla firm działających na rynkach regulowanych lub pracujących nad poufnymi projektami, wdrożenie lokalnych rozwiązań AI może być nie tylko kwestią wygody, ale koniecznością prawną i elementem budowania zaufania klientów. W dłuższej perspektywie rozwój wydajniejszych, zoptymalizowanych modeli neuronowych może sprawić, że to nie nieskończona skalowalność chmury, a właśnie niezależność i bezpieczeństwo staną się głównym motorem innowacji w AI.

Wyzwania na krawędzi: ograniczenia mocy i wydajności w urządzeniach końcowych

Realizacja wizji obliczeń na krawędzi, gdzie analiza danych odbywa się tuż obok ich źródła, napotyka fundamentalną barierę: fizyczne ograniczenia samych urządzeń końcowych. W przeciwieństwie do chmury dysponującej niemal nieograniczoną skalą mocy i chłodzenia, inteligentna kamera, czujnik przemysłowy czy urządzenie noszone muszą mieścić się w kompaktowej obudowie, często zasilanej bateryjnie. To wymusza trudny kompromis między wydajnością a poborem energii. Procesor w smartfonie, który ma w czasie rzeczywistym przetwarzać obraz z kamery dla aplikacji AR, nie może działać z mocą serwerowego CPU i zachować przyzwoitego czasu pracy na baterii. Oto kluczowe wyzwanie: jak przetworzyć lawinę danych przy ścisłych, fizycznych limitach energetycznych.

Architekci systemów odpowiadają na to wyzwanie poprzez głęboką specjalizację i rozproszenie zadań. Zamiast polegać na jednym, uniwersalnym, lecz prądożernym CPU, nowoczesne urządzenia końcowe integrują wyspecjalizowane akceleratory. Są to układy zaprojektowane do konkretnych operacji, takich jak przetwarzanie sieci neuronowych (NPU) czy manipulacja macierzami w procesach uczenia maszynowego. Taki układ wykonuje wąskie zadanie nieporównywalnie wydajniej i oszczędniej niż główny procesor. Przykładem jest rozpoznawanie mowy w inteligentnym głośniku – zadanie to przejmuje wyspecjalizowany, niskomocowy koprocesor, pozwalając głównym jednostkom pozostawać w stanie uśpienia, co radykalnie oszczędza energię.

Ostatecznie sukces w obliczeniach brzegowych zależy od synergii trzech elementów: energooszczędnego sprzętu, lekkich algorytmów oraz inteligentnej dystrybucji zadań. Coraz powszechniejsze staje się podejście hybrydowe, gdzie urządzenie końcowe wykonuje wstępną, szybką filtrację i analizę lokalnie, przesyłając do chmury jedynie wyjątki lub zagregowane wnioski. To redukuje wolumen przesyłanych danych, opóźnienia i obciążenie sieci. Projektowanie dla krawędzi to zatem sztuka precyzyjnego balansu, gdzie każdy miliwat mocy i każda operacja obliczeniowa muszą być uzasadnione, a celem nie jest maksymalna moc, lecz optymalna inteligencja w danych ograniczeniach.

Przewodnik po chipsetach: jakie procesory napędzają rewolucję Edge AI?

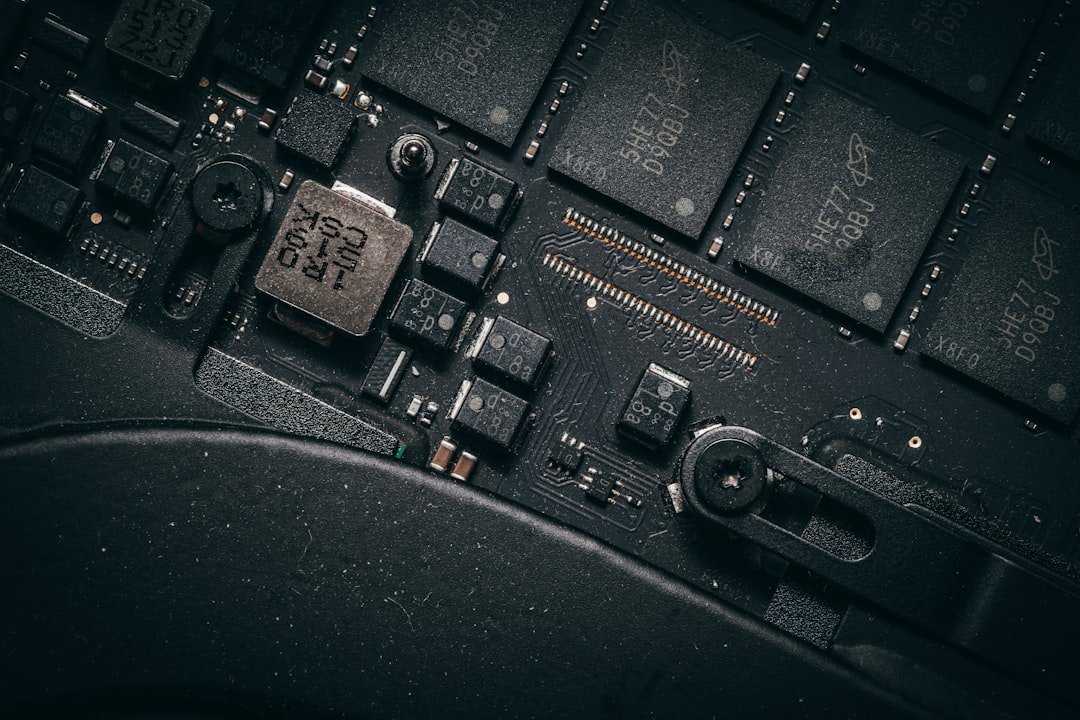

Rewolucja Edge AI nie byłaby możliwa bez równoległej ewolucji układów scalonych, które odeszły od tradycyjnego paradygmatu obliczeniowego. Kluczem okazała się specjalizacja. Podczas gdy uniwersalne procesory CPU pozostają niezbędne do zarządzania zadaniami, to układy typu NPU (Neural Processing Unit) oraz zoptymalizowane GPU przejęły ciężar inferencji, czyli wnioskowania na podstawie wytrenowanych modeli. Te wyspecjalizowane jednostki zaprojektowano od podstaw do błyskawicznego i energooszczędnego wykonywania tysięcy równoległych operacji matematycznych, charakterystycznych dla sieci neuronowych. To właśnie ich obecność odróżnia współczesny chipset dla sztucznej inteligencji od zwykłego procesora, czyniąc go sercem inteligentnego urządzenia brzegowego.

Na rynku obserwujemy wyraźny podział architektur. Producenci tacy jak Qualcomm z serią Snapdragon czy MediaTek z liniami Dimensity integrują zaawansowane, ale wciąż mobilne, akceleratory AI bezpośrednio w swoich systemach-on-chip (SoC) dla smartfonów i lekkich urządzeń. Z drugiej strony, firmy jak NVIDIA z platformą Jetson lub Intel z układami Movidius oferują bardziej wydajne, często modułowe rozwiązania dla robotyki, dronów czy zaawansowanych systemów wizyjnych. Ciekawym trendem jest rosnąca rola procesorów APU (Accelerated Processing Unit), które łączą CPU, GPU i dedykowany blok AI w jednej, spójnej architekturze, widocznej w najnowszych chipach AMD Ryzen dla laptopów.

Ostateczny wybór chipsetu napędzającego Edge AI zależy od konkretnego zastosowania. Dla ciągłego monitorowania wideo w inteligentnej kamerze kluczowy będzie niski pobór mocy i wysoka wydajność w zadaniach wizyjnych. W autonomicznym wózku widłowym priorytetem stanie się niezawodność i możliwość przetwarzania danych z wielu czujników jednocześnie. Dlatego przy projektowaniu rozwiązań brzegowych inżynierowie muszą brać pod uwagę nie tylko surową moc obliczeniową (TOPS), ale także efektywność energetyczną, wsparcie dla konkretnych frameworków uczenia maszynowego oraz zdolność do pracy w wymagających warunkach. Przyszłość należy do chipsetów oferujących nie wszechstronność, lecz precyzyjnie dopasowaną architekturę do wąskiego zakresu zadań AI.

<h2 class="wp-block