Jak Edge AI w smartfonie rozpoznaje i poprawia zdjęcie, zanim je zrobisz?

Dziesięć lat temu o jakiejkolwiek „obróbce” zdjęcia można było mówić dopiero po kliknięciu migawki. Dziś, dzięki sztucznej inteligencji działającej na krawędzi sieci, cały proces zachodzi w ułamku sekundy, który dzieli decyzję od jej realizacji. Sekret tkwi w przeniesieniu mocy obliczeniowej AI bezpośrednio do procesora telefonu, co pozwala uniknąć opóźnień związanych z komunikacją z chmurą. Specjalizowany blok NPU lub układ neuromorficzny w chipsecie analizuje na bieżąco strumień danych z sensora, identyfikując scenę, obiekty i warunki oświetleniowe, zanim piksele zostaną utrwalone na stałe. To zasadnicza zmiana filozofii – aparat przestaje być biernym rejestratorem światła, a staje się jego aktywnym interpretatorem.

Dzięki tej wstępnej, precyzyjnej analizie, skomplikowane korekty są aplikowane w momencie tworzenia fotografii. Gdy system wykryje twarz w półmroku, potrafi błyskawicznie dostosować nie tylko jasność, ale i wyostrzyć detale, redukując szum dokładnie w newralgicznych partiach kadru. Rozpoznając pejzaż, może w locie wzmocnić błękit nieba i soczystość zieleni, zachowując przy tym naturalny balans. Jeśli w kadrze pojawi się ruchomy obiekt, algorytmy przewidzą jego tor i zoptymalizują pracę migawki oraz stabilizacji, by uniknąć rozmazania. Wszystkie te operacje odbywają się lokalnie, co zapewnia nie tylko natychmiastowość, ale i pełnię prywatności – żaden bajt naszych obrazów nie opuszcza urządzenia.

W efekcie współczesny smartfon działa jak fotograficzny asystent obdarzony zdolnością przewidywania. Gdy tradycyjne przetwarzanie przypominało wywoływanie już naświetlonego filmu, Edge AI jest jak operator, który w trakcie nagrania na bieżąco koryguje parametry. Użytkownik otrzymuje więc nie surowy zapis rzeczywistości, lecz jej zoptymalizowaną wizję, często oddającą intencję, której nie potrafiłby sam wyeksponować manualnie. To właśnie owa proaktywna inteligencja, działająca na krawędzi, sprawia, że fotografowanie telefonem jest tak intuicyjne i konsekwentnie daje satysfakcjonujące efekty, bez względu na warsztat osoby trzymającej aparat.

Dlaczego neuromorficzny chip to więcej niż "szybki procesor" – to architektura mózgu.

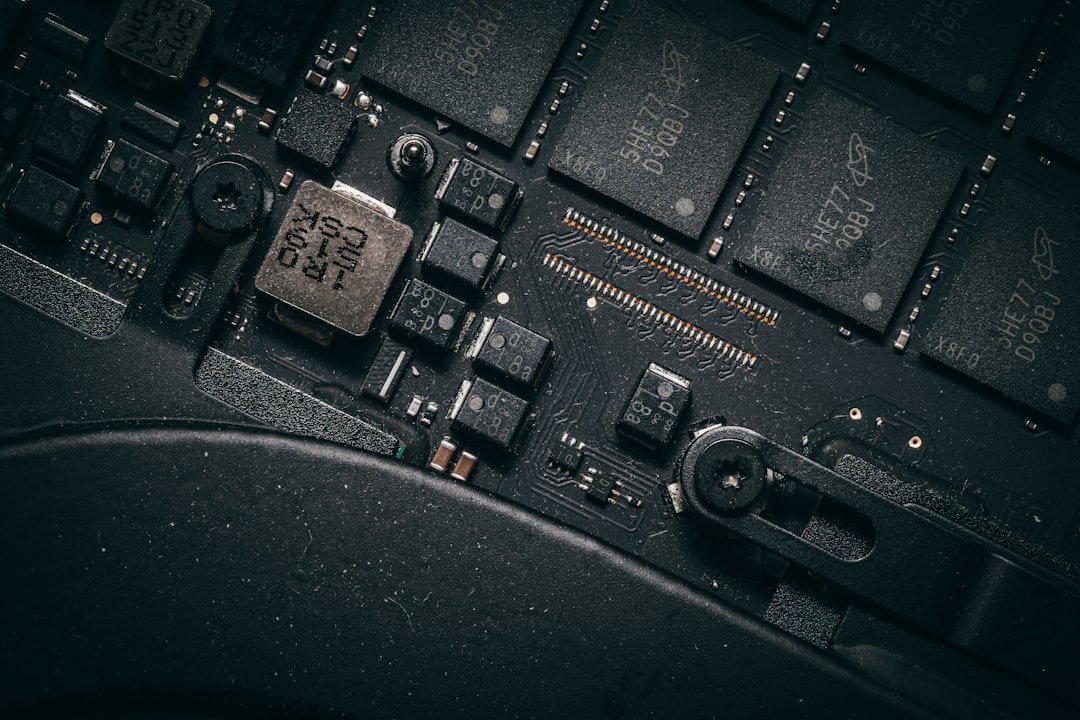

Rozmawiając o chipach neuromorficznych, łatwo ulec pokusie porównań z tradycyjnymi CPU czy GPU, oceniając je wyłącznie przez pryzmat częstotliwości taktowania i liczby operacji na sekundę. To jednak błąd, który przesłania istotę rewolucji. Sednem nie jest przyspieszenie znanych nam obliczeń, lecz wprowadzenie radykalnie nowego paradygmatu przetwarzania, wzorowanego na biologicznych sieciach neuronowych. Gdzie klasyczny procesor wykonuje instrukcje krok po kroku, architektura neuromorficzna naśladuje równoległą, asynchroniczną pracę miliardów prostych jednostek – neuronów – połączonych synapsami o zmiennej wadze. To właśnie ta struktura, a nie czysta prędkość, nadaje jej unikalny charakter.

Różnica ta ma fundamentalne znaczenie dla działania i efektywności energetycznej. Nawet bardzo wydajny system konwencjonalny traci ogromne zasoby na nieustanne przesyłanie danych między pamięcią a jednostką obliczeniową, co określa się mianem wąskiego gardła von Neumanna. Chip neuromorficzny zaciera ten podział, integrując przechowywanie i przetwarzanie w rozproszonej sieci połączeń. Działa asynchronicznie – „neurony” aktywują się tylko w odpowiedzi na docierający sygnał, a nie w rytm zewnętrznego zegara. W praktyce przekłada się to na niebywałą wydajność w zadaniach takich jak analiza strumieni wideo czy filtrowanie dźwięku z tła, przy poborze mocy bliższym pracy ludzkiego mózgu niż serwerowni.

Ostateczny potencjał tej architektury wykracza poza naśladowanie ludzkiej inteligencji. Chodzi o stworzenie maszyn, które myślą w sposób odmienny od naszych komputerów – nie przez ślepe wykonywanie kodu, ale przez adaptacyjne uczenie się i wnioskowanie w izolacji. Wyobraźmy sobie autonomiczne roboty badające głębiny oceanu, które muszą reagować na niespodziewane przeszkody z opóźnieniem milisekund, lub czujniki przemysłowe wykrywające anomalie bez przesyłania terabajtów surowych danych. Neuromorficzny chip to zatem nie kolejny, mocniejszy silnik, lecz projekt zupełnie nowego pojazdu, stworzonego od podstaw do podróży przez nieuporządkowany, analogowy świat.

Od surowych danych do gotowego zdjęcia: jak AI na krawędzi redefiniuje "obróbkę".

Klasyczna obróbka cyfrowa, nawet w smartfonach, przez długi czas przypominała działanie na odległość. Surowy plik z matrycy wędrował do chmury lub głównego procesora, gdzie aplikowano zestaw standardowych poprawek. Dziś ten model odchodzi do przeszłości za sprawą sztucznej inteligencji działającej na krawędzi, czyli bezpośrednio w urządzeniu. Oznacza to, że cała alchemia przekształcania danych w olśniewające piksele dokonuje się lokalnie, w mgnieniu oka i bez angażowania sieci. To już nie jest nakładanie filtrów, lecz kompleksowa, inteligentna interpretacja sceny w czasie rzeczywistym.

Klucz leży w głębi analizy, jaką AI na krawędzi przeprowadza na surowym strumieniu z sensora. Zamiast stosować uniwersalne ulepszenia, sieć neuronowa rozpoznaje konkretne elementy – twarz, liście, nocne niebo, fakturę materiału – i dla każdego z nich dobiera indywidualne parametry. Gdy fotografujesz zachód słońca, algorytm może jednocześnie przyciemnić niebo dla bogatszych kolorów, ocalić detale w sylwetkach na pierwszym planie i wyciszyć szum w cieniach, traktując każdy fragment obrazu z osobna. To jak noszenie w kieszeni cyfrowego laboranta, który potrafi odgadnąć zamiary fotografa.

Ta redefinicja obróbki przenosi punkt ciężkości z korekty po fakcie na inteligentne kreowanie obrazu w chwili naciśnięcia migawki. Proces staje się przewidujący i uwzględniający kontekst. W praktyce otrzymujemy zdjęcia o lepszej dynamice i naturalności w wymagających warunkach, przy niemal zerowym opóźnieniu. Dodatkowo, prywatność zyskuje nową warstwę ochrony, ponieważ najbardziej osobiste kadry nigdy nie opuszczają fizycznych granic telefonu. W ten sposób AI na krawędzi nie tylko przyspiesza i uszlachetnia efekt końcowy, ale zasadniczo zmienia filozofię fotografii, czyniąc z każdego urządzenia autonomiczne, kreatywne studio.

Twoje zdjęcia nigdy nie opuszczają telefonu: koniec z chmurą w fotografii mobilnej.

Przez lata chmura wydawała się oczywistym, a nawet jedynym rozsądnym wyborem dla miłośników fotografii mobilnej. Automatyczna synchronizacja, dostęp z dowolnego miejsca i pozorna nieskończoność przestrzeni tworzyły wygodną iluzję bezpieczeństwa. Jednak coraz więcej osób zaczyna dostrzegać drugą stronę medalu. Nasze prywatne wspomnienia, od rodzinnych uroczystości po codzienne selfie, wędrują do odległych centrów danych, stając się przedmiotem złożonych regulacji, potencjalnych naruszeń lub po prostu usługą zależną od abonamentu. Zdjęcie istniejące wyłącznie w chmurze jest w gruncie rzeczy jedynie obietnicą jego wyświetlenia, uzależnioną od łącza i dobrej woli dostawcy.

W odpowiedzi na te obawy rodzi się trend, który można nazwać „powrotem do korzeni” fotografii. Nowoczesne smartfony oferują dziś pojemności sięgające terabajtów, co pozwala przechowywać dziesiątki tysięcy zdjęć w pełnej jakości bezpośrednio w urządzeniu. To zupełnie inna filozofia zarządzania pamięcią, wymagająca większej świadomości, ale dająca bezprecedensową kontrolę. Twoja galeria staje się wtedy prawdziwie osobistym albumem, fizycznie obecnym w kieszeni, a nie wirtualnym bytem rozproszonym po serwerach. Co kluczowe, zaawansowane procesory umożliwiają również pełną obróbkę zdjęć na miejscu, eliminując potrzebę wysyłania surowych plików do chmury celem zastosowania filtrów.

Praktycznym odzwierciedleniem tej zmiany jest ewolucja oprogramowania. Aplikacje do edycji, takie jak Darkroom czy Pixelmator, oferują potężne narzędzia działające w pełni offline, a kopie zapasowe można tworzyć na prywatnych, fizycznych dyskach. To rozwiązanie przypomina cyfrowy odpowiednik odbitek wywołanych w ciemni, które chowamy do szuflady – mamy do nich bezpośredni i natychmiastowy dostęp, bez żadnych pośredników. Ostatecznie wybór między chmurą a pamięcią lokalną nie jest już kwestią technologicznego postępu, lecz osobistej preferencji dotyczącej prywatności, autonomii i realnego poczucia posiadania swoich cyfrowych wspomnień.

Personalizacja bez inwigilacji: jak Edge AI uczy się Twoich preferencji w trybie offline.

W czasach powszechnej troski o prywatność, idea spersonalizowanych usług często budzi skojarzenia z nieustannym śledzeniem naszej aktywności online. Tu właśnie pojawia się przełomowa wartość Edge AI, czyli sztucznej inteligencji działającej na urządzeniu końcowym. Jej kluczową zaletą jest zdolność do uczenia się i adaptacji bez przesyłania wrażliwych informacji na zewnętrzne serwery. Cały proces personalizacji odbywa się lokalnie, w trybie offline, analizując wyłącznie dane generowane na Twoim smartfonie, laptopie czy inteligentnym głośniku.

Mechanizm jest jednocześnie prosty i skuteczny. Weźmy pod uwagę klawiaturę mobilną, która z czasem zaczyna przewidywać charakterystyczne dla nas zwroty i poprawiać nawykowe błędy. Algorytm Edge AI obserwuje lokalne wzorce pisania, by stopniowo dostosowywać sugestie. Podobnie działa system rekomendacji muzyki, który analizuje, jakie utwory odtwarzamy o różnych porach i przy różnych aktywnościach, tworząc idealnie dopasowane playlisty, które nigdy nie opuszczają urządzenia. To nauka przez obserwację, a nie inwigilację.

Fundamentalna różnica w porównaniu do modeli chmurowych leży w miejscu przetwarzania. Tradycyjna AI zbiera dane od milionów użytkowników, by wytrenować jeden, centralny model. Edge AI działa odwrotnie – każdy model jest unikalny i wyspecjalizowany dla pojedynczego użytkownika oraz jego urządzenia. Nie otrzymuje on zewnętrznych aktualizacji o globalnych trendach, lecz rozwija się wyłącznie w oparciu o bezpośrednie interakcje. Dzięki temu nasze preferencje nie stają się towarem, a my zyskujemy wymierne korzyści z automatyzacji.

Oczywiście, to podejście ma swoje granice. Personalizacja w trybie offline z natury ogranicza się do kontekstu, który urządzenie może samo zaobserwować, i nie może nagle polecić nam knajpki w nowym mieście bez dostępu do szerszej bazy. Jest to jednak świadomy kompromis, który wielu użytkowników zaczyna doceniać. Edge AI oferuje więc nową filozofię: technologia może być zarówno pomocna, jak i dyskretna, ucząc się naszych przyzwyczajeń po cichu, w zaciszu własnego sprzętu, gdzie dana naprawdę pozostają naszą własnością.

Wyzwania: co ogranicza neuromorficzne AI w dzisiejszych smartfonach?

Mimo że neuromorficzne układy AI zapowiadają rewolucję w efektywności, ich integracja z obecnymi smartfonami napotyka poważne przeszkody. Podstawową barierą jest sama architektura, wymagająca radykalnie innego podejścia do projektowania chipów. Nawet dedykowane akceleratory AI wciąż często operują w ramach tradycyjnego paradygmatu z oddzielną pamięcią i jednostkami obliczeniowymi, co generuje wspomniane wąskie gardło von Neumanna. Prawdziwie neuromorficzny układ, naśladujący biologiczny mózg poprzez integrację pamięci i obliczeń, potrzebuje nowych materiałów i technik produkcyjnych. Obecne fabryki są zoptymalizowane dla krzemu, podczas gdy przyszłe rozwiązania mogą wymagać memrystorów lub innych komponentów wciąż testowanych w laboratoriach.

Kolejnym istotnym wyzwaniem jest ekosystem oprogramowania. Całe środowisko rozwoju aplikacji mobilnych, od popularnych frameworków po miliony istniejących programów, zbudowano wokół klasycznych modeli obliczeniowych. Przeniesienie tego na architekturę neuromorficzną, która często najlepiej sprawdza się w modelu zdarzeniowym (sieci impulsujące), wymagałoby przepisania od podstaw algorytmów i przeszkolenia rzeszy developerów. Bez dojrzałej warstwy oprogramowania, która ukryje tę złożoność, nawet najwydajniejszy hardware pozostanie bezużyteczny dla masowego odbiorcy. Ponadto, neuromorficzne AI obecnie błyszczy w wyspecjalizowanych zadaniach, jak przetwarzanie sygnałów czujników, podczas gdy konsumenci oczekują uniwersalnych funkcji, jak zaawansowana obróbka zdjęć.

Wreszcie, kluczową kwestią pozostaje ekonomia i odczuwalna wartość. Producenci smartfonów działają na niezwykle konkurencyjnym rynku, gdzie każdy cent kosztów ma znaczenie. Wprowadzenie egzotycznego, drogiego w rozwoju układu neuromorficznego musiałoby przynieść wyraźną, namacalną korzyść, której nie da się osiągnąć przez dalsze optymalizowanie konwencjonalnych akceleratorów AI. Na dziś, oszczędność baterii przy wąskim zakresie zadań może nie być wystarczającym argumentem marketingowym. Dlatego komercyjny debiut tej technologii w smartfonach prawdopodobnie nastąpi stopniowo, początkowo w formie wyspecjalizowanych koprocesorów do konkretnych zastosowań, a nie jako główny silnik obliczeniowy.

Przyszłość: od aparatu do osobistego asystenta – co dalej z Edge AI w Twojej kieszeni?

Dziś nasze telefony potrafią rozpoznać twarz,